Résumé d’ouverture: En 2026, il est courant de constater que certaines pages disparaissent brutalement des résultats Google puis réapparaissent quelques semaines plus tard. Les moteurs de recherche adaptent constamment leurs règles, et votre visibilité dépend de nombreux facteurs allant de l’indexation à la vitesse de chargement, en passant par la structure du site et la qualité du contenu. Cet article propose une explication détaillée des mécanismes de crawl et d’indexation, décrypte les causes fréquentes de disparition et propose des solutions concrètes pour restaurer et stabiliser le référencement. Vous verrez comment diagnostiquer rapidement les signaux d’alerte, corriger les erreurs techniques et ajuster votre stratégie de contenu afin d’éviter les retours en arrière provoqués par des mises à jour d’algorithme ou par des pénalités discrètes. Des exemples réels, des conseils pratiques et des ressources utiles permettent d’aborder ce phénomène avec méthode et sérénité, tout en restant conforme aux bonnes pratiques d’optimisation SEO.

Brief

Une bonne gestion de l'indexation et des erreurs techniques contribue à assurer la visibilité continue de vos pages, tout comme une bonne rémunération motive les développeurs.

Savoir comment maintenir la visibilité de ses pages web peut aussi inspirer des idées pour vivre des sensations fortes avec une box pilotage sur circuit.

Adopter une approche stratégique pour l'angle de votre article est essentiel lorsque le mot-clé est trop large, afin d'optimiser votre référencement.

L'intégration d'une FAQ pertinente peut également renforcer la stratégie de référencement sans risquer la sur-optimisation.

Ce guide explore pourquoi une page peut disparaître de Google et revenir ensuite, en s’appuyant sur les mécanismes d’indexation, de crawl et sur les causes majeures telles que les contenus dupliqués, les mises à jour d’algorithme, et les défauts techniques. Il propose un chemin d’analyse et d’intervention étape par étape, avec des exemples concrets et des liens vers des ressources spécialisées pour approfondir chaque étape. Vous découvrirez comment rétablir l’indexation, redresser le référencement et pérenniser le trafic sans recourir à des méthodes risquées.

En bref

- Une disparition temporaire peut résulter d’un problème d’indexation ou d’un problème de crawl, souvent lié à une mise à jour d’algorithme ou à une erreur 404.

- Le contenu dupliqué, une structure interne mal pensée et une vitesse de chargement lente fragilisent le référencement et favorisent les baisses de position.

- La mise à jour des algorithmes peut modifier le paysage des résultats, en privilégiant les contenus de qualité, les backlinks pertinents et l’indexation efficace.

- Pour récupérer rapidement, il faut diagnostiquer les causes, corriger les erreurs et solliciter une réindexation via les outils adéquats, en évitant les pénalités et les erreurs 404.

Pourquoi une page peut disparaître de Google et revenir ensuite: comprendre l’indexation et le crawl

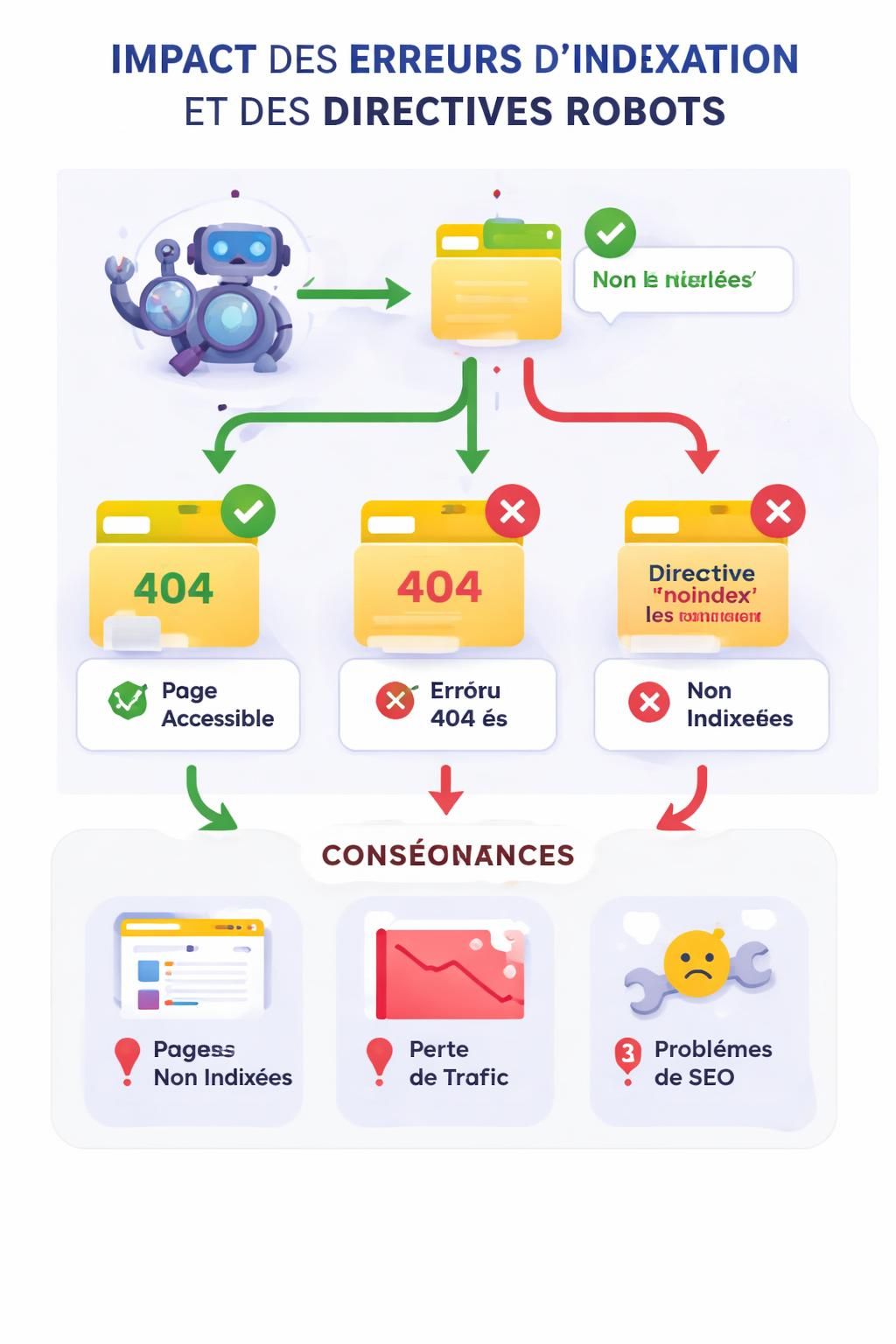

Pour saisir pourquoi une page peut disparaître puis réapparaître sur Google, il faut d’abord comprendre deux mécanismes centraux du fonctionnement du moteur de recherche: l’indexation et le crawl. L’indexation correspond à l’ingestion et à l’analyse des pages par les robots qui parcourent le web. Le crawl est le processus par lequel ces robots découvrent et suivent les liens pour accéder à de nouvelles pages et mettre à jour les données. Une page disparaît lorsque son contenu n’est plus aperçu ou considéré comme valide par l’algorithme en charge du classement, ou lorsque des éléments techniques bloquent son exploration. Dans ce contexte, une erreur 404 ou une balise noindex peut suffire à exclure une page des résultats, même si elle était bien positionnée auparavant.

Une bonne pratique consiste à surveiller régulièrement l’indexation des pages via les outils dédiés, comme la Search Console, et à vérifier que le fichier robots.txt et les balises noindex n’interfèrent pas par inadvertance avec des pages importantes. Il est également crucial de comprendre que les mises à jour d’algorithme peuvent modifier le poids relatif accordé au contenu, à la structure et aux signaux externes tels que les backlinks. Dans ce cadre, la notion de crawl est fondamentale: si les robots rencontrent des redirections mal configurées, des liens cassés ou une navigation confuse, ils peuvent explorer moins de pages ou interpréter certains éléments comme moins pertinents, entravant l’indexation et le référencement.

Dans cet esprit, il est utile d’associer ces notions à des cas concrets: par exemple, une page qui a été temporairement bloquée par une bannière ou un script peut sembler disparaître, mais elle peut revenir rapidement une fois le script désactivé et le crawl réactivé. À l’inverse, une page qui reste bloquée par une erreur 404 sans solution de redirection cohérente peut mettre du temps à réapparaître même après correction, car Google peut continuer à considérer l’arborescence comme obsolète. Pour prévenir ce genre de situation, il est recommandé d’établir une cartographie des URLs critiques et de vérifier régulièrement leur état via des rapports d’audit, en s’assurant que les pages majeures restent accessibles et indexables à tout moment. En complément, prenez l’habitude d’intégrer des sitemaps à jour et de tester les pages à l’aide d’outils comme le “Inspect URL” de Google pour évaluer l’accès et l’indexation.

Les mécanismes de conversion d’un problème d’indexation en problème de visibilité

Lorsqu’une page est bloquée pour des raisons techniques, l’effet sur le référencement peut être immédiat ou progressif. Par exemple, une erreur 404 peut survenir lorsque la page est supprimée ou déplacée sans redirection appropriée. Si Google ne peut plus accéder à la page, elle n’est plus crawlée et, par conséquent, n’est plus indexée. L’influence de ce signal dépend aussi de la valeur perçue de la page: s’il s’agit d’un contenu historique sans trafic, les moteurs peuvent réduire l’importance accordée à sa récupération rapide, même après rétablissement technique. À l’inverse, pour une page clé générant du trafic régulier, la correction peut être rapide et voir le retour dans les résultats en quelques jours, après réindexation.

Pour approfondir, vous pouvez consulter des ressources sur les mécanismes d’indexation et les évolutions d’algorithme, notamment dans les guides dédiés à l’optimisation et au référencement. Ces ressources expliquent comment l’indexation est affectée par les balises et les entêtes, comment le crawl privilégie certaines sections de votre site, et comment les mises à jour d’algorithme influent sur la manière dont Google évalue la pertinence et l’autorité des pages. En pratique, il est utile d’associer une approche technique rigoureuse (contrôles robots, redirections, erreurs 404 gérées) avec une démarche éditoriale axée sur la qualité et l’originalité du contenu.

Les 10 causes fréquentes de disparition et leur mécanisme de retour

Les baisses de visibilité ne surviennent pas par hasard: elles reflètent une interaction entre des facteurs techniques, éditoriaux et algorithmiques. Connaître les dix causes les plus courantes permet non seulement d’identifier rapidement ce qui se passe, mais aussi de corriger le tir et de prévenir les récurrences. Dans cette section, chaque cause est détaillée avec des exemples concrets et des solutions opérationnelles, afin de vous donner des outils clairs pour rétablir votre présence dans les résultats et maintenir une dynamique de référencement positive. Nous verrons comment les balises, le contenu, les performances techniques et l’écosystème externe interagissent pour influencer la position et la lisibilité de vos pages, et comment agir sur chaque facteur avec précision.

1) Problèmes d’indexation et de robots.txt

Une balise noindex mal placée ou un fichier robots.txt mal configuré peut bloquer l’exploration et l’indexation. Ce phénomène est fréquent lorsque des pages importantes se retrouvent involontairement hors du flux d’exploration. Le premier réflexe est de vérifier que les pages clefs sont bien autorisées et que les directives noindex ne s’appliquent pas par erreur. L’analyse doit s’effectuer sur le plan technique et éditorial: quelles pages sont bloquées et pourquoi? Un bon diagnostic passe par la comparaison entre les pages indexées et celles bloquées, ainsi que par un contrôle des redirections qui pourraient masquer des URLs contentieuses. Pour aller plus loin, explorez les pratiques recommandées dans les guides dédiés à l’indexation et à l’optimisation, et n’hésitez pas à corriger les anomalies détectées dans le fichier robots.txt et dans les balises meta. Des ressources externes comme celles-ci peuvent vous aider à comprendre les implications et les bonnes pratiques pour éviter les erreurs d’indexation.

Liste utile d’actions à réaliser:

- Vérifier le fichier robots.txt pour chaque répertoire important.

- Revoir les balises noindex sur les pages stratégiques et les en-têtes HTTP.

- Tester les URLs via l’outil d’inspection d’URL et demander une réindexation si nécessaire.

- Mettre à jour le guide sur les techniques de marketing digital pour aligner les pratiques d’indexation avec les standards du moment et le contexte 2026.

Installez une routine de contrôle mensuel des pages clefs et sur les éventuelles pages bloquées. Une bonne pratique est de documenter les changements et d’associer chaque modification à une action mesurable sur le trafic et l’indexation. L’objectif est d’éviter les continentales périodes d’inactivité qui peuvent conduire à des pénalités progressives et à des baisses durables du référencement.

La vitesse de chargement, l’utilisation des données structurées et la qualité du contenu influencent aussi l’indexation et le crawl: un site lent ou peu clair peut voir les robots préférer explorer d’autres pages. Pour des perspectives pratiques sur l’optimisation SEO, consultez les ressources sur les stratégies de croissance pour les PME et les techniques efficaces de marketing digital.

En complément, la gestion des erreurs 404 et des redirections est cruciale pour éviter les expériences utilisateur décevantes et les signaux négatifs qui affectent l’indexation et le référencement.

2) Contenu dupliqué et crédibilité

Le contenu dupliqué est un piège commun qui peut entraîner une perte de positions et, dans certains cas, une pénalité légère ou une réduction de visibilité pour les pages jugées redondantes. Google privilégie l’originalité et la valeur ajoutée. Lorsque plusieurs pages offrent des contenus similaires, le moteur peut choisir une version dominante et déprioriser les autres, réduisant ainsi l’impact global du site. Le traitement du contenu dupliqué passe par une stratégie de redaction unique et pertinente, par une consolidation des pages superflues et par l’utilisation de balises canoniques lorsque plusieurs URLs pointent vers la même ressource. Il est essentiel de vérifier les sources de duplication internes et externes et d’appliquer des solutions ciblées: consolidation, réécriture, ou redirection appropriée vers la version principale.

Pour éviter le piège, privilégiez une approche centrée sur la valeur ajoutée pour l’utilisateur. Les contenus doivent apporter une information nouvelle, des exemples concrets et des cas d’usage pertinents pour votre audience. En parallèle, assurez-vous que les pages qui ne nécessitent pas une présentation distincte reposent sur une structure consolidée et bien référencée via des liens internes pertinents. La consolidation des contenus obsolètes et l’actualisation régulière des articles renforcent la crédibilité et la valeur perçue par les moteurs de recherche.

Intégrer des liens internes pertinents et des ressources externes de qualité peut aussi aider à distiller le signal de pertinence et à éclaircir les situations de contenu dupliqué. Par exemple, vous pouvez lire des analyses et des guides sur l’évolution des pratiques de contenu et les stratégies de croissance pour les PME pour nourrir votre approche éditoriale et votre plan d’optimisation.

En complément, la mise à jour régulière des contenus et l’évaluation continue de leur performance restent des leviers essentiels pour préserver le référencement et éviter le déclin lié à des contenus devenus obsolètes.

Processus de récupération et bonnes pratiques pour rétablir le référencement après une disparition

Lorsqu’une page a disparu des résultats, la démarche de récupération doit être méthodique et mesurée. Le point de départ est un bilan technique et éditorial: vérifier les erreurs d’accès, les redirections, et les signaux d’indexation. Sur le plan technique, assurez-vous que les pages essentielles ne présentent pas d’erreurs 404, que les redirections 301 pointent vers des URLs pertinentes et que le fichier sitemap est à jour et accessible. Sur le plan éditorial, assurez-vous que le contenu est original, utile et actualisé. L’objectif est de remettre la page dans le périmètre d’exploration et de démontrer à Google qu’elle mérite d’être réindexée et réévaluée dans le cadre du classement. Une étape clé consiste à tester le rendu et l’accessibilité via l’outil d’inspection d’URL et à solliciter une réindexation si nécessaire.

Pour accélérer le processus, vous pouvez effectuer les actions suivantes:

- Mettre en place des redirections 301 propres et correctement configurées pour les URLs évincées ou déplacées.

- Mettre à jour le contenu et enrichir la page d’exemples concrets, d’études de cas et de données récentes.

- Soumettre la page via l’outil d’inspection d’URL et demander une réindexation.

- Optimiser les performances et la vitesse de chargement, en particulier sur mobile, pour répondre aux exigences de l’algorithme actuel.

Pour approfondir, vous pouvez consulter des ressources sur les stratégies de croissance et les techniques efficaces de marketing digital qui détaillent les meilleures pratiques pour améliorer l’éventail des signaux de référencement et la synergie entre contenu et performance technique.

Par ailleurs, l’adaptation à l’environnement mobile et l’usage des données structurées peuvent aider à clarifier le contenu pour les robots et les utilisateurs. L’objectif est d’éviter les erreurs qui fragilisent le crawl et l’indexation et de rétablir le trafic de manière durable. En lien avec cela, découvrez les ressources sur les stratégies de croissance et les bonnes pratiques du marketing digital, qui permettent de renforcer la crédibilité et le positionnement de vos pages après une disparition.

Cas pratiques et analyses: exemples réels de disparition et de réapparition sur Google

Dans le monde du référencement, les cas concrets illustrent les mécanismes qui sous-tendent la disparition et le retour des pages. Prenons l’exemple d’un site e-commerce qui, après une mise à jour algorithmique, a vu certaines fiches produits perdues dans les résultats. Le diagnostic a révélé une combinaison de contenu dupliqué entre fiches similaires, une vitesse de chargement retardée et des liens internes peu pertinents menant vers des pages peu utilisées. En réponse, l’équipe a réécrit les descriptions pour élever le niveau d’information et d’originalité, consolidé les pages similaires, et corrigé les redirections. En quelques semaines, les fiches ont regagné leur positionnement, mais pas sans un travail soutenu sur la vitesse et sur la structure du site. Ce genre de situation illustre l’importance de la surveillance continue et de l’adaptation rapide à l’évolution des règles du jeu d’indexation et de crawl.

Un autre exemple concerne un blog industriel qui a subi une bann temporaire après une série d’erreurs techniques, notamment des liens cassés et des pages d’aperçu mangées par des scripts obsolètes. La réponse a été méthodique: nettoyer les liens cassés, remplacer les pages obsolètes par des versions actualisées et mettre en place une cadence éditoriale plus rigoureuse pour éviter le retour du problème. Ensuite, des pages ont été réindexées manuellement, et les visites organiques ont progressivement rebondi. Ces exemples démontrent que les signaux de détection et les actions correctives doivent être cohérents et alignés sur une stratégie globale de référencement.

Tableau de synthèse des facteurs et des actions recommandées:

| Élément | Impact sur l’indexation | Actions correctives |

|---|---|---|

| Problèmes d’indexation | Crawl limité, pages non indexées | Vérifier robots.txt, balises noindex, réindexation |

| Contenu dupliqué | Dépriorisation des pages, perte de trafic | Consolider, réécrire, utiliser des balises canoniques |

| Mises à jour d’algorithme | Réévaluation des pages selon qualité et pertinence | Améliorer contenu, backlinks, expérience utilisateur |

| Vitesse de chargement | Expérience utilisateur et crawling plus lents | Optimiser images, code, hébergement; tests de performance |

Les enseignements tirés des cas montrent qu’aucune solution miracle n’existe: chaque disparition est le résultat d’un ensemble d’éléments qui interagissent. Pour vous prémunir contre les retours de ce type, il est utile d’adopter une approche proactive et itérative: audit régulier, mise à jour du contenu, amélioration technique continue et suivi des indicateurs clés comme le taux d’indexation et les mouvements de positionnement. En parallèle, l’examen des bonnes pratiques et des tendances du secteur peut aider à adapter votre stratégie et à mieux préparer votre site à faire face aux futures évolutions des algorithmes.

Prévenir l’apparition de disparitions: stratégies d’optimisation SEO et suivi continu

Prévenir les disparaissances et les retours est l’objectif ultime d’une stratégie SEO durable. Cela passe par une combinaison d’approches techniques et éditoriales:

– Assurer une indexation fluide et durable en surveillant les signaux d’erreur et en garantissant l’accessibilité des pages essentielles.

– Maintenir une base de contenu unique et actualisée, en évitant le contenu dupliqué et en renouvelant régulièrement les articles qui ont le plus de trafic.

– Renforcer les performances du site: réduction de la taille des images, minification du code et optimisation du rendu côté serveur.

– Consolider le maillage interne pour faciliter le crawl et éviter que des pages ne soient négligées.

– Diversifier et cultiver le profil de backlinks de manière qualitative, en évitant les schémas artificiels qui peuvent entraîner des pénalités punitives.

Pour approfondir ces aspects et vous inspirer des meilleures pratiques, consultez les ressources suivantes: Soft 404: éviter les erreurs et guide complet des stratégies de croissance pour PME.

Des pratiques concrètes d’optimisation incluent la mise en place d’un calendrier éditorial axé sur des sujets pertinents, la consolidation des pages sous-performantes et l’application systématique des redirections lorsque des URLs deviennent obsolètes. En parallèle, l’audit technique régulier et l’utilisation d’un plan d’action clair permettent de réduire les risques de pénalité et d’améliorer le référencement sur le long terme. Le recours à des contenus de qualité, cohérents et bien structurés est l’un des leviers les plus efficaces pour renforcer la crédibilité du site et soutenir la indexation.

Pour aller plus loin, explorez les ressources dédiées au marketing digital et à la référence web, qui apportent des conseils actualisés pour optimiser l’ensemble des signaux de référencement en 2026. Les pratiques éthiques et durables permettent d’assurer une visibilité robuste et pérenne face aux évolutions des algorithmes et des attentes des utilisateurs.

Pourquoi une page peut disparaître de Google ?

Plusieurs facteurs peuvent être à l’origine: problèmes d’indexation, contenu dupliqué, mises à jour d’algorithme, erreurs techniques (404, crawl bloqué), vitesse lente, ou pénalités.

Comment vérifier si ma page est bloquée par noindex ou robots.txt ?

Utilisez l’outil Inspect URL de Google et vérifiez le fichier robots.txt et les balises noindex sur la page. Comparez les pages indexées avec celles qui ne le sont pas.

Que faire si j’observe une erreur 404 sur mes pages importantes ?

Diagnostiquer la cause, mettre en place une redirection 301 vers une page équivalente ou mise à jour, et demander la réindexation. Corriger rapidement les défauts pour limiter les pertes de trafic.

Comment éviter les pénalités et préserver le référencement lors des mises à jour d’algorithme ?

S’investir dans du contenu unique et utile, soigner le netlinking de qualité, améliorer l’expérience utilisateur et éviter les techniques manipulatrices. Adopter une approche durable et conforme aux règles des moteurs.